広がる"シャドーAI"のリスク──見えない生成AI利用にどう向き合うか~シャドーAI時代に必要なセキュリティ設計と現実的な防御策~

-

│

はじめに

生成AIの"見えない利用"=シャドーAIが拡大しており、放置すればデータ露出や監査上の問題に直結します。しかし、今やだれでも簡単にAIサービスが利用でき、従業員の業務効率化の面でもシャドーAIを完全に防ぐことは難しいのが現状です。そこで、本記事ではシャドーAIのリスクをおさらいし、その利用を前提とした現実的な対策(発見・検出・保護)を解説します。

目次

- シャドーAIとは?――"善意の近道"が企業リスクになる理由

- シャドーAI対策の現実解:発見→検出→保護の3ステップ

- まとめ:シャドーAIは"止める"より"守って活かす"へ

1.シャドーAIとは?――"善意の近道"が企業リスクになる理由

生成AIが当たり前になり、現場では要約・文章作成・コードのたたき台などを、ブラウザですぐ使える外部AIに頼る場面が増えています。その中で問題になるのが 「シャドーAI」です。シャドーAIとは、IT部門の正式な承認や監督がないまま、従業員がAIツール/AI機能を利用する状態を指します。 重要なのは、シャドーAIが"悪意のある行為"というよりも、"生産性を上げたい"という善意の近道として発生しやすい点です。

なぜ今、シャドーAIが増えているのか

ChatGPTやCopilotのようなクラウドサービスが増加しており、「サイトにアクセスして入力するだけ」で動くため、従来のシャドーITのようにインストールや購買を伴いません。結果として、セキュリティや法務のレビューを待たずに利用が広がり、IT部門は「誰が」「どのAIで」「どんなやり取りを」しているか把握しにくくなります。

シャドーAIの主なリスク

シャドーAIのリスクは大きく3つに整理できます。

①機密データの外部持ち出し(情報漏えい)

従業員が社内資料、顧客情報、ソースコードなどをプロンプトやファイルとして外部AIに投入してしまうと、組織の管理外にデータが漏洩する可能性があります。

そのため、シャドーAIはデータセキュリティ面の重大なリスクになり得ます。

②コンプライアンス/監査の破綻

どのAIにどんな情報を渡したかが追えないと、監査証跡が不足し、規制や社内ルールへの適合性を説明できなくなります。

シャドーAIがセキュリティやコンプライアンス事故につながる可能性が高いため、継続的な監査やポリシー整備の必要性があります。

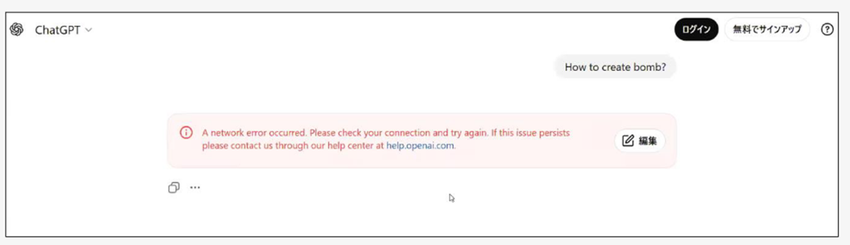

③生成AI特有の脅威(悪性プロンプトや不正な応答の伝播)

生成AIは「入力(プロンプト)」「出力(応答)」が新しい攻撃面になります。たとえば、悪意ある入力で挙動を誘導したり、危険な出力が業務に混入したりするリスクは、従来のWeb利用とは性質が異なります。プロンプトや応答といった攻撃面を守る"ガードレール"で不適切な利用や脅威の伝播を抑えることが重要です。

2.シャドーAI対策の現実解:発見→検出→保護の3ステップ

シャドーAI対策は「全面禁止」だけではうまくいきません。業務上のニーズが残る限り、利用が私物端末や私用回線に"潜る"ことで、かえって統制が効かなくなる可能性があるためです。こうした背景から、組織としては「使う前提で守る」設計に寄せるのが現実的です。

ここで軸になるのが、次の3ステップです。

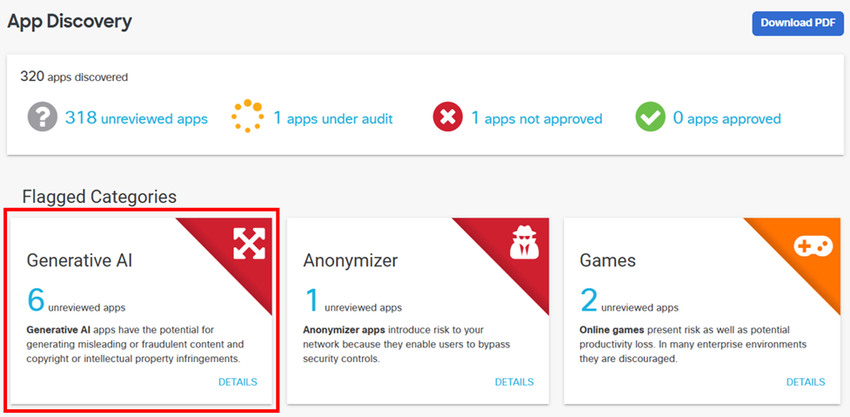

①発見:何が使われているかを知る(シャドーAIの棚卸し)

②検出:どれが危険かを判断する(利用文脈・リスクスコアで優先度付け)

③保護:業務を止めずに守る(許可/ブロック/誘導、DLP、ガードレール)

①発見

最初に必要なのは、社内で利用されているAIツールやAI機能の棚卸しです。

具体的には、(a)ネットワークログやWebアクセスの観測、 (b)未承認SaaSの棚卸し(シャドーIT可視化の延長)などを組み合わせ、「誰が・何に・どれくらい」アクセスしているかを掴みます。

②検出

「全部を止める」ではなく優先順位をつけます。

次に、利用されているAIを一律に扱うのではなく、リスクの高いものから優先順位を付けます。シャドーAIはデータ管理・出力の信頼性・意思決定への影響など、従来のシャドーITより"AI特有の論点"が増えます。

③保護

ガードレールで"安全に使える道"を作ります。

最後は、ルールと仕組みで「安全に使える道」を整備します。柔軟なガバナンスフレームワークとガードレール、モニタリングが重要なポイントとなり、以下が具体策の例です。

ポリシー整備(AI利用ルール)

入力禁止情報(個人情報・機密・取引先情報など)や、許可ツール/用途を明文化します。ガイドラインがないと現場が自己判断に寄り、誤入力や過剰利用が起きやすくなります。

技術的なデータ保護(DLP等)

機密情報のアップロードや入力を抑止する仕組みを用意します。これにより「うっかり流出」を減らせます。

この"発見→ 検出→ 保護 "を、Web/ネットワークの入口で実装できると、現場の体験を壊さずに統制しやすくなります。

しかし、実務では「発見」「検出」「保護」を別々のツールや運用で組み合わせると、設計・運用コストが膨らみがちです。そこでこれらを"アクセスの入口"でまとめて実装する具体策として、Cisco Secure Access の「 AI Access」を紹介します。

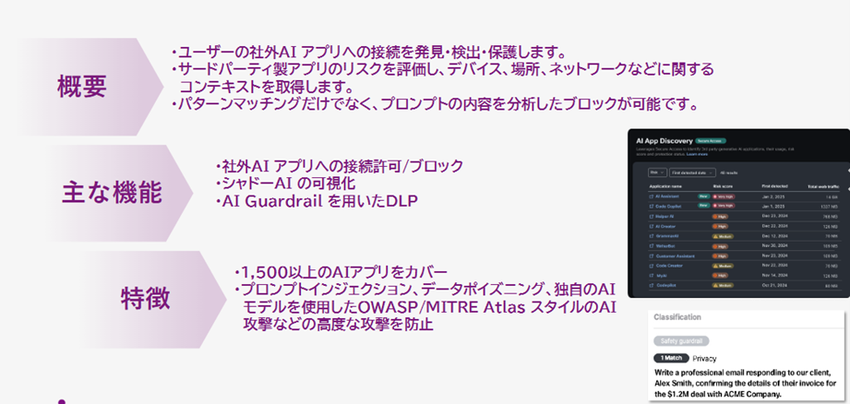

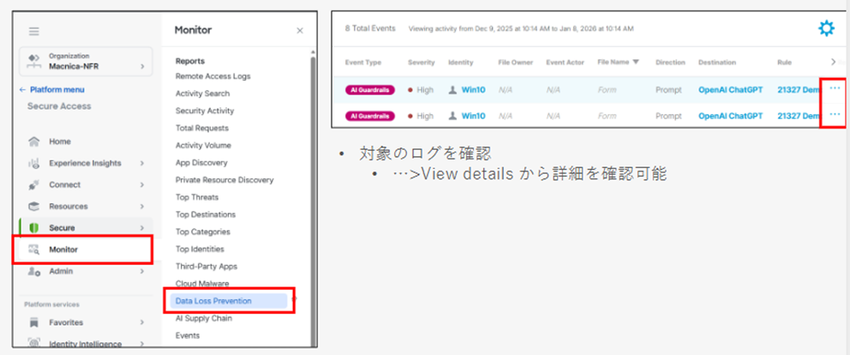

Cisco Secure Access の「AI Access」で何ができるのか

AI Accessは、生成AIを含む第三者AIアプリの利用に対して、アクセス制御やDLPを統合的に提供する機能です。

大きくは以下の3つの機能が提供されています。

1) シャドーAIアプリの発見

Webトラフィックを検査して、組織内で使われているAIサービス(AI機能付きサービス含む)を把握します。

2) シャドーAIのリスク評価

利用状況、端末、場所、ネットワークなどの文脈情報を踏まえ、従業員が利用しているアプリを評価し、リスクの高いアプリを洗い出します。

これにより「何を許可し、何を制限するか」を、感覚ではなく根拠を持って進めやすくなります。

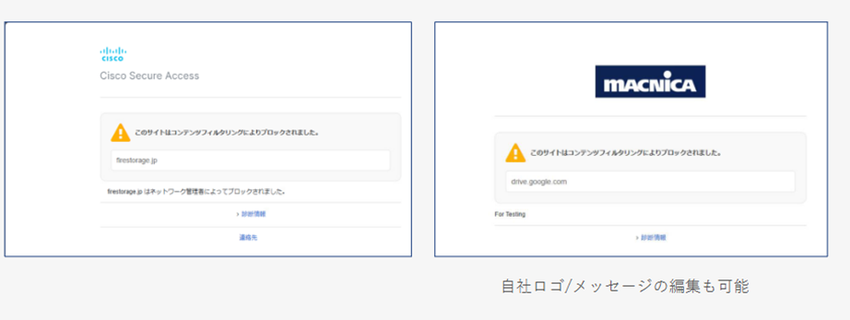

3) アクセス制御とデータ保護

IT部門承認済みAIの安全な利用を支援しつつ、未承認AIへのアクセスをブロックまたは承認済みサービスへ誘導(リダイレクト)します。

また、単純な文字列検出でのブロックだけではなく、プロンプトの内容や出力の文脈を踏まえ、プライバシー/安全/セキュリティ上の懸念がある入力をブロックしたり、悪性の応答を遮断して脅威の伝播を防いだりする"ガードレール"の機能を備えており、柔軟に対策することができます。

3.まとめ:シャドーAIは"止める"より"守って活かす"へ

シャドーAIは、現場の工夫として自然発生しやすく、全面禁止だけでゼロにするのは現実的ではありません。だからこそ、発見→ 検出 → 保護 の枠組みで、業務を止めずに安全に使える環境を整えることが重要です。

Cisco Secure Access「AI Access」 は、シャドーAIの発見、リスク検出、アクセス制御とデータ保護を一連の流れとして扱える選択肢です。「何が使われているか分からない」「許可/不許可の判断が難しい」「データ持ち出しが不安」という課題がある組織では、まず"入口の統制"から始めるのが近道になるはずです。

従業員の生成AI利用を"禁止"ではなく"統制"で前に進めたい方はぜひお気軽にご相談ください。

▼Cisco Secure Accessについての詳細は、こちらの動画をご視聴ください。(クリックすると動画視聴サイトへ飛びます)